混训到混推,DeepLink筑牢多元算力赋能“人工智能+”基座

来源:上海人工智能实验室| 2026-03-09

全球人工智能正加速向通用人工智能(AGI)演进,大模型对高效、稳定、低成本的算力需求持续攀升。如能解决多元芯片异构智算集群间算力调度难、利用率低等瓶颈,将为释放异构算力潜能,实现高效协同,为迈向AGI筑牢算力基座。

继2025年以DeepLink混训技术方案,实现跨千公里多智算中心长稳混训千亿参数大模型,上海人工智能实验室(上海AI实验室)将“战果”拓展至大模型推理环节,于近期推出了DeepLink多元算力混合推理加速方案(以下简称“DeepLink混推方案”)实现了对昇腾、沐曦、平头哥和壁仞等多款芯片混合调度与协同推理。

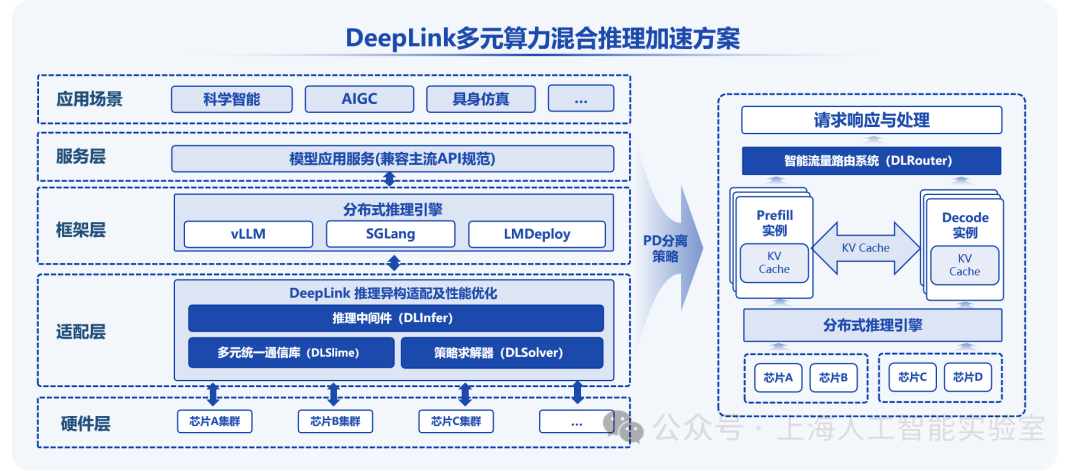

当前的国产算力推理方案仅能支持单一集群的算力调度,因而无法适配多元芯片异构场景。DeepLink混推方案基于统一推理中间件、低时延通信、智能流量路由、策略求解器等原创技术,不仅可对多款芯片混合调度与协同推理,在性能方面亦大幅提升,与单一芯片方案对比推理时延TTFT最大可优化34.5%,推理吞吐提升32%。

随着DeepLink混推方案的发布,原创“训练+推理”全方位算力赋能体系逐步成型,为全国智能算力互联互通、高效盘活分散算力资源探索出新路径,为“人工智能+”行动落地提供稳定、灵活、高效、低成本的算力支撑。

DeepLink 官网:https://deeplink.org.cn/home

DeepLink Github:https://github.com/DeepLink-org

技术突破:开放、高效、协同的中国方案

在传统大模型推理架构中,输入输出阶段对应的预填充(Prefill)和解码(Decode)任务共享同一组计算资源,极易因资源争抢而导致服务响应卡顿,影响用户体验。预填充-解码分离(PD分离)策略根据芯片特性进行了精准的职能划分,可有效避免计算资源的争抢。

基于单一芯片集群的PD分离推理策略,已成为业界主流推理优化应用方向,而面向国产异构芯片的协同推理,仍是当前行业亟待攻克的关键难题。受商业壁垒与核心技术保护等因素影响,各芯片厂商间缺乏互联互通、协同调度的原生动力与统一标准,导致异构算力协同问题长期难以妥善解决。如何盘活分散、闲置的异构存量算力,将“成本中心”转化为“价值中心”,仍是产业发展亟需破解的核心命题。

上海AI实验室肩负着破解“算力围城”、探索多元算力使用最优解的责任,科研团队将预填充-解码分离(PD分离)策略运用在国产异构算力中,验证了混合芯片高效协同推理的路径——数据中心内不同规格属性的芯片组合优化使用,形成最具性价比的异构算力配比,实现国产芯片“用得好、用得值”,同时为激活多元算力生态提供了新模式。

在具体实现层面,科研团队通过构建推理中间件DLInfer、高速通信库DLSlime、智能流量路由系统DLRouter与策略求解器DLSolver四大原创技术底座,实现了对异构算力资源的兼容调度。

推理中间件(DLInfer):以标准化融合算子接口打通上层框架与底层硬件壁垒,实现算法模型在多元硬件上的统一推理,降低应用门槛。

DLInfer 仓库:https://github.com/DeepLink-org/dlinfer

高速通信库(DLSlime):全面兼容各类主流物理连接协议,实现跨架构设备高速互联,核心场景带宽利用率突破97%;具有较强的异步处理能力,可实现计算与通信的重叠。

DLSlime 仓库:https://github.com/DeepLink-org/DLSlime

智能流量路由系统(DLRouter):支持KVCache感知的请求路由,最大限度减少重复或重叠请求,节省计算资源,实现分布式集群负载均衡分配。

策略求解器(DLSolver):自动获取异构芯片全方位评测数据,结合模型配置以及用户服务等级目标等输入,匹配最优PD分离配置策略,兼顾推理性能与成本。

基于上述多种技术突破,DeepLink混推方案具有精准匹配算力密集型、访存密集型硬件的能力,并同时兼顾推理时延与吞吐性能。另外,该方案还具备良好的可扩展性,能有效的应用于Attention-FFN(AF)分离等其他场景。

成效提升:生产环境应用实现1+1>2

上海AI实验室在国产芯片优化领域已完成大量技术攻关与实践积累,基于现有技术积淀科研团队已完成单一算力平台推理加速验证,相关技术也已在基础设施上实现规模化应用:在昇腾A2上,针对千卡规模下的化学数据生成场景,实现了61.9%的吞吐率提升;在沐曦曦云C500上,实现MinerU多模态生成推理加速60%。

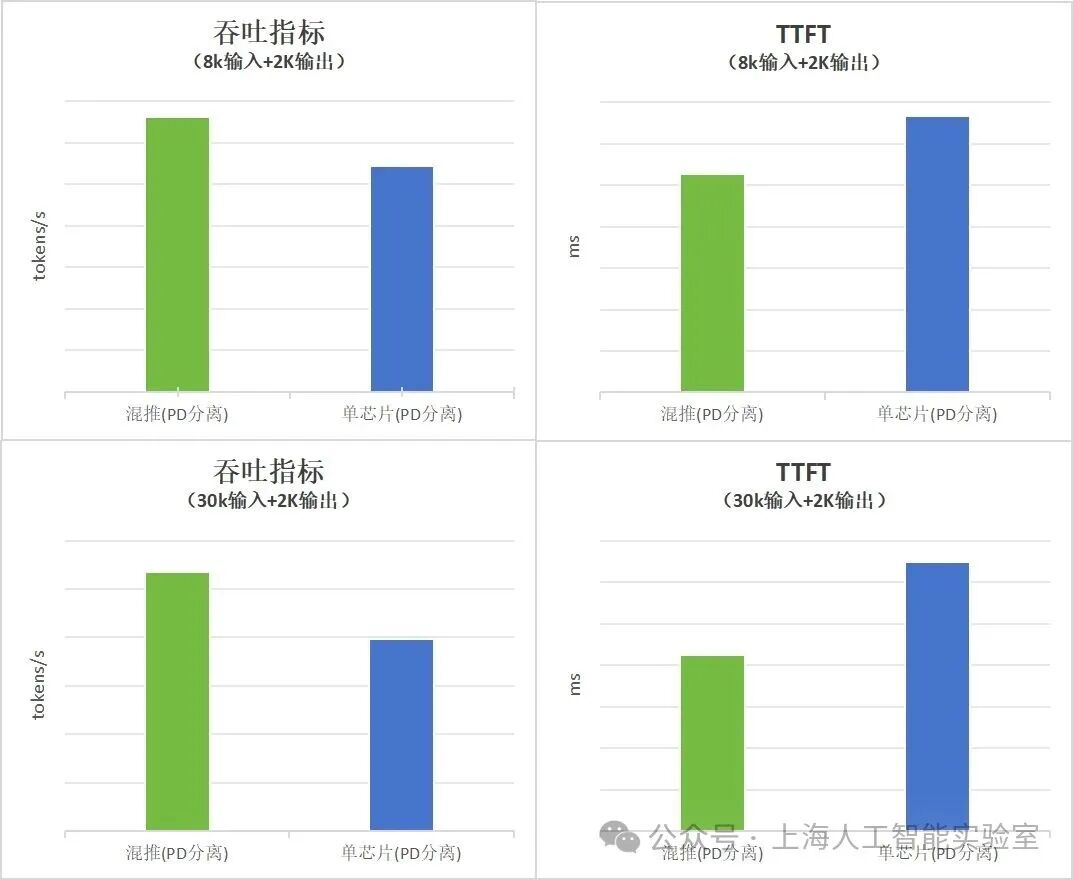

在此基础上,DeepLink 混推方案进一步和多款硬件深度适配,首次实现包括昇腾、沐曦、平头哥和壁仞在内的多款国产芯片的深度混合调度与协同推理。千卡规模推理集群实测数据表明,在多模态生成、高并发智能服务等典型场景下,本方案相较于单芯片方案推理时延TTFT最大可优化34.5%;在科学论文处理等长输入短输出推理任务中,本方案相较于单芯片PD分离方案,推理吞吐提升32%。DeepLink混推方案已实现了国产异构芯片“1+1>2”的效能跃升,而科研团队在多元异构算力协同上的技术探索与实践洞察,也为AGI时代的超智融合异构算力建设与生态融合发展提供了重要经验参考。

DeepLink混推方案与单芯片方案对比

全面布局:筑牢多元算力赋能“人工智能+”基座

2025年7月,上海AI实验室发布DeepLink超大规模跨域混训技术方案,成功攻克超大规模跨域异构集群调度、高性能通信协议整合、高可靠容错机制设计等技术难题,可支持千公里多智算中心跨域长稳混训千亿参数大模型,实现等效算力达单芯片单集群算力的95%以上,并完成与运营商、云厂商、模型厂商的多个集成项目落地。

随着DeepLink混推方案的推出,上海AI实验室逐步构建起混合“训练+推理”全方位算力赋能体系,为算力资源的高效调度、多元协同与生态融通筑牢技术底座。在计算资源有限的场景下,赋能行业运用不同性能芯片的灵活组合,而无需依赖高算力芯片“扎堆”式部署,有效降低对特定硬件的路径依赖。DeepLink平台加速了国产异构芯片的大规模应用,基于繁荣的自主算力生态为更多企业拥抱“人工智能+”创造机会,为中国打造新质生产力增添新动能。